هذا الشهر ، قدم جيريمي هوارد ، باحث الذكاء الاصطناعي روبوت محادثة عبر الإنترنت اتصل الدردشة لابنته البالغة من العمر 7 سنوات. تم إصداره قبل أيام قليلة من قبل OpenAI ، أحد أكثر مختبرات الذكاء الاصطناعي طموحًا في العالم.

قال لها أن تسأل روبوت الدردشة التجريبي عما يخطر ببالها. سألت عن سبب استخدام علم المثلثات ، ومن أين أتت الثقوب السوداء ولماذا احتضنت الدجاج بيوضها. في كل مرة كانت تجيب بنثر واضح ومنقط. عندما طلبت برنامج كمبيوتر يمكنه التنبؤ بمسار الكرة التي تُلقى في الهواء ، أعطاها ذلك أيضًا.

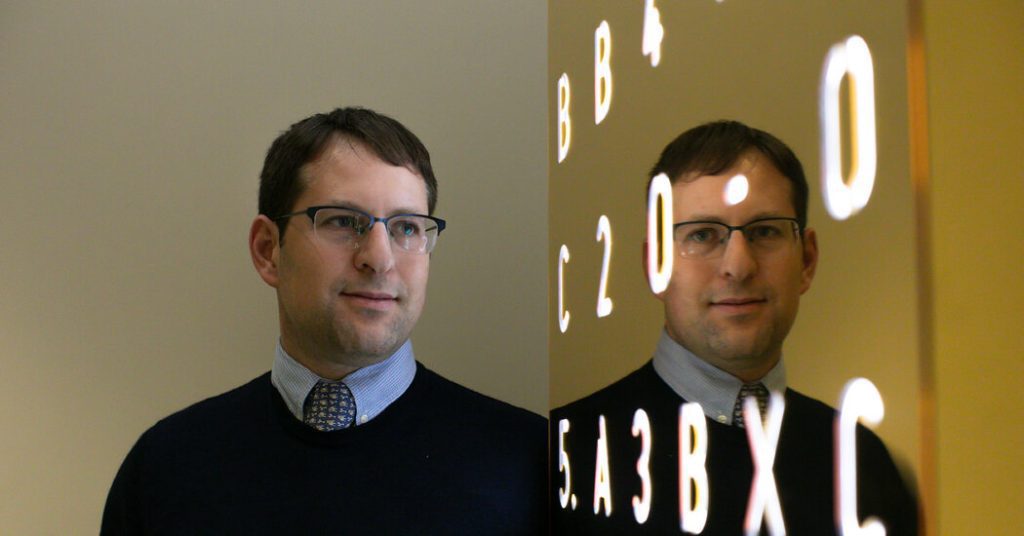

خلال الأيام القليلة المقبلة ، السيد هوارد – عالم بيانات وأستاذ الذي ألهم عمله إنشاء ChatGPT وتقنيات مماثلة – جاء لرؤية روبوت الدردشة كنوع جديد من المدرس الشخصي. يمكن أن تعلم ابنته الرياضيات والعلوم واللغة الإنجليزية ، ناهيك عن بعض الدروس المهمة الأخرى. أهمها: لا تصدق كل ما يقال لك.

قال: “إنه لمن دواعي سروري أن أراها تتعلم بهذه الطريقة”. “لكنني أخبرتها أيضًا: لا تثق في كل شيء يمنحك إياه. يمكن أن يخطئ “.

OpenAI من بين العديد من الشركات والمختبرات الأكاديمية والباحثين المستقلين الذين يعملون على بناء روبوتات دردشة أكثر تقدمًا. لا تستطيع هذه الأنظمة الدردشة تمامًا مثل الإنسان ، ولكن يبدو أنهم في كثير من الأحيان. يمكنهم أيضًا استرداد المعلومات وإعادة تجميعها بسرعة لا يستطيع البشر أبدًا القيام بها. يمكن اعتبارهم مساعدين رقميين – مثل Siri أو Alexa – أفضل في فهم ما تبحث عنه ومنحه لك.

بعد إصدار ChatGPT – الذي استخدمه أكثر من مليون شخص – يعتقد العديد من الخبراء أن روبوتات الدردشة الجديدة هذه تستعد لإعادة اختراع أو حتى استبدال محركات البحث على الإنترنت مثل Google و Bing.

يمكنهم تقديم المعلومات في جمل ضيقة ، بدلاً من قوائم طويلة من الروابط الزرقاء. يشرحون المفاهيم بطرق يمكن للناس فهمها. ويمكنهم تقديم الحقائق ، مع إنشاء خطط العمل ، والموضوعات الورقية ، والأفكار الجديدة الأخرى من البداية.

قال آرون ليفي ، الرئيس التنفيذي لشركة Silicon Valley ، Box ، وأحد المديرين التنفيذيين العديدين الذين يستكشفون الطرق التي ستتغير بها روبوتات الدردشة هذه: “لديك الآن جهاز كمبيوتر يمكنه الإجابة على أي سؤال بطريقة منطقية للإنسان”. المشهد التكنولوجي. “يمكن أن يستنبط ويأخذ الأفكار من سياقات مختلفة ودمجها معًا.”

تقوم روبوتات الدردشة الجديدة بذلك بما يبدو أنه ثقة تامة. لكنهم لا يقولون الحقيقة دائمًا. في بعض الأحيان ، يفشلون حتى في العمليات الحسابية البسيطة. يمزجوا الحقيقة مع الخيال. ومع استمرارها في التحسن ، يمكن للناس استخدامها توليد ونشر الأكاذيب.

صعود أوبن إيه آي

شركة سان فرانسيسكو هي واحدة من أكثر مختبرات الذكاء الاصطناعي طموحًا في العالم. فيما يلي نظرة على بعض التطورات الأخيرة.

قامت Google مؤخرًا ببناء نظام خاص للمحادثة ، يسمى LaMDA ، أو نموذج اللغة لتطبيقات الحوار. هذا الربيع ، مهندس جوجل ادعى أنه كان واعيًا. لم يكنلكنها استحوذت على خيال الجمهور.

كان آرون مارغوليس ، عالم البيانات في أرلينغتون بولاية فيرجينيا ، من بين العدد المحدود من الأشخاص خارج Google الذين سُمح لهم باستخدام LaMDA من خلال تطبيق Google التجريبي ، AI Test Kitchen. كان دائمًا مندهشًا من موهبته في محادثة مفتوحة. لقد أبقاه مستمتعا. لكنه حذر من أنه قد يكون نوعًا من الخرافات – كما كان متوقعًا من نظام تم تدريبه من كميات هائلة من المعلومات المنشورة على الإنترنت.

قال: “ما يمنحك هو نوعًا ما مثل فيلم آرون سوركين”. كتب السيد سوركين فيلم “The Social Network” ، وهو فيلم غالبًا ما يتم انتقاده لتوسيع نطاق الحقيقة حول أصل موقع Facebook. “أجزاء منه ستكون صحيحة ، وأجزاء لن تكون صحيحة.”

طلب مؤخرًا من كل من LaMDA و ChatGPT التحدث معه كما لو كان مارك توين. عندما سأل LaMDA ، سرعان ما وصف الاجتماع بين توين وليفي شتراوس ، وقال إن الكاتب عمل مع قطب الجينز الأزرق أثناء إقامته في سان فرانسيسكو في منتصف القرن التاسع عشر. بدا ذلك صحيحًا. لكنه لم يكن. عاش توين وستراوس في سان فرانسيسكو في نفس الوقت ، لكنهما لم يعملا معًا أبدًا.

يطلق العلماء على هذه المشكلة اسم “هلوسة”. يشبه إلى حد كبير راوي القصص الجيد ، فإن روبوتات الدردشة لديها طريقة لأخذ ما تعلموه وإعادة تشكيله إلى شيء جديد – دون أي اعتبار لما إذا كان صحيحًا أم لا.

LaMDA هو ما يسميه باحثو الذكاء الاصطناعي أ الشبكة العصبية، وهو نظام رياضي تم تصميمه بشكل غير محكم على شبكة الخلايا العصبية في الدماغ. هذه هي نفس التكنولوجيا التي يترجم بين الفرنسية والإنجليزية على خدمات مثل ترجمة Google ويحدد المشاة على أنهم السيارات ذاتية القيادة تتنقل في شوارع المدينة.

تتعلم الشبكة العصبية المهارات من خلال تحليل البيانات. من خلال تحديد الأنماط في آلاف صور القطط ، على سبيل المثال ، يمكن أن يتعلم التعرف على قطة.

قبل خمس سنوات ، بدأ باحثون في Google ومختبرات مثل OpenAI في تصميم الشبكات العصبية التي حلل كميات هائلة من النصوص الرقمية، بما في ذلك الكتب ومقالات ويكيبيديا والقصص الإخبارية وسجلات الدردشة عبر الإنترنت. يسميها العلماء “نماذج اللغة الكبيرة”. من خلال تحديد المليارات من الأنماط المتميزة في الطريقة التي يربط بها الأشخاص الكلمات والأرقام والرموز ، تعلمت هذه الأنظمة إنشاء نص بمفردها.

فاجأت قدرتهم على توليد اللغة العديد من الباحثين في هذا المجال ، بما في ذلك العديد من الباحثين الذين قاموا ببنائها. يمكن للتقنية أن تحاكي ما كتبه الناس وتجمع بين مفاهيم متباينة. يمكنك أن تطلب منه كتابة مشهد “سينفيلد” حيث يتعلم جيري تقنية رياضية مقصورة على فئة معينة تسمى خوارزمية فرز الفقاعة – و من شأنه.

مع ChatGPT ، عملت OpenAI على تحسين التكنولوجيا. إنه لا يقوم بمحادثة حرة التدفق مثل LaMDA من Google. تم تصميمه للعمل بشكل أكبر مثل Siri و Alexa والمساعدين الرقميين الآخرين. مثل LaMDA ، تم تدريب ChatGPT على بحر من النصوص الرقمية المستخرجة من الإنترنت.

عندما اختبر الناس النظام ، طلب منهم تقييم ردوده. هل كانوا مقنعين؟ هل كانت مفيدة؟ هل كانوا صادقين؟ ثم من خلال تقنية تسمى تعزيز التعلم، فقد استخدمت التصنيفات لصقل النظام وتحديد ما سيفعله وما لن يفعله بعناية أكبر.

قالت ميرا موراتي ، رئيسة قسم التكنولوجيا في OpenAI: “يتيح لنا ذلك الوصول إلى النقطة التي يمكن للنموذج أن يتفاعل معك ويعترف عندما يكون خطأ”. “يمكنه رفض شيء غير مناسب ، ويمكنه تحدي سؤال أو فرضية غير صحيحة.”

الطريقة لم تكن مثالية. حذرت شركة OpenAI أولئك الذين يستخدمون ChatGPT من أنها “قد تولد أحيانًا معلومات غير صحيحة” و “تنتج تعليمات ضارة أو محتوى متحيزًا.” لكن الشركة تخطط لمواصلة تحسين التكنولوجيا ، وتذكر الأشخاص الذين يستخدمونها بأنها لا تزال مشروعًا بحثيًا.

تعالج Google و Meta وشركات أخرى أيضًا مشكلات الدقة. ميتا مؤخرا إزالة معاينة عبر الإنترنت لروبوت الدردشة الخاص به ، Galactica ، لأنه ينتج بشكل متكرر معلومات غير صحيحة ومتحيزة.

وحذر الخبراء من أن الشركات لا تتحكم في مصير هذه التقنيات. تعتمد أنظمة مثل ChatGPT و LaMDA و Galactica على الأفكار والأوراق البحثية ورموز الكمبيوتر التي تم تداولها بحرية لسنوات.

يمكن لشركات مثل Google و OpenAI دفع التكنولوجيا إلى الأمام بمعدل أسرع من غيرها. لكن أحدث تقنياتهم أعيد إنتاجها وتوزيعها على نطاق واسع. لا يمكنهم منع الناس من استخدام هذه الأنظمة لنشر المعلومات الخاطئة.

تمامًا كما كان السيد هوارد يأمل أن تتعلم ابنته ألا تثق في كل شيء تقرأه على الإنترنت ، كان يأمل أن يتعلم المجتمع الدرس نفسه.

قال: “يمكنك برمجة الملايين من هذه الروبوتات لتبدو وكأنها بشر ، وإجراء محادثات مصممة لإقناع الناس بوجهة نظر معينة”. لقد حذرت من هذا منذ سنوات. من الواضح الآن أن هذا ينتظر حدوثه “.

“متعطش للطعام. طالب. متحمس محترف للزومبي. مبشر شغوف بالإنترنت.”

More Stories

الذهب يسجل أسوأ أداء شهري منذ 17 عامًا وسط ضغوط الدولار والطاقة

الدولار يسجل مستوى قياسيًا أمام الجنيه المصري

مع تصاعد التوترات في المنطقة: الحكومة تؤكد جاهزية مخزون السلع والطاقة وتدرس إجراءات استثنائية